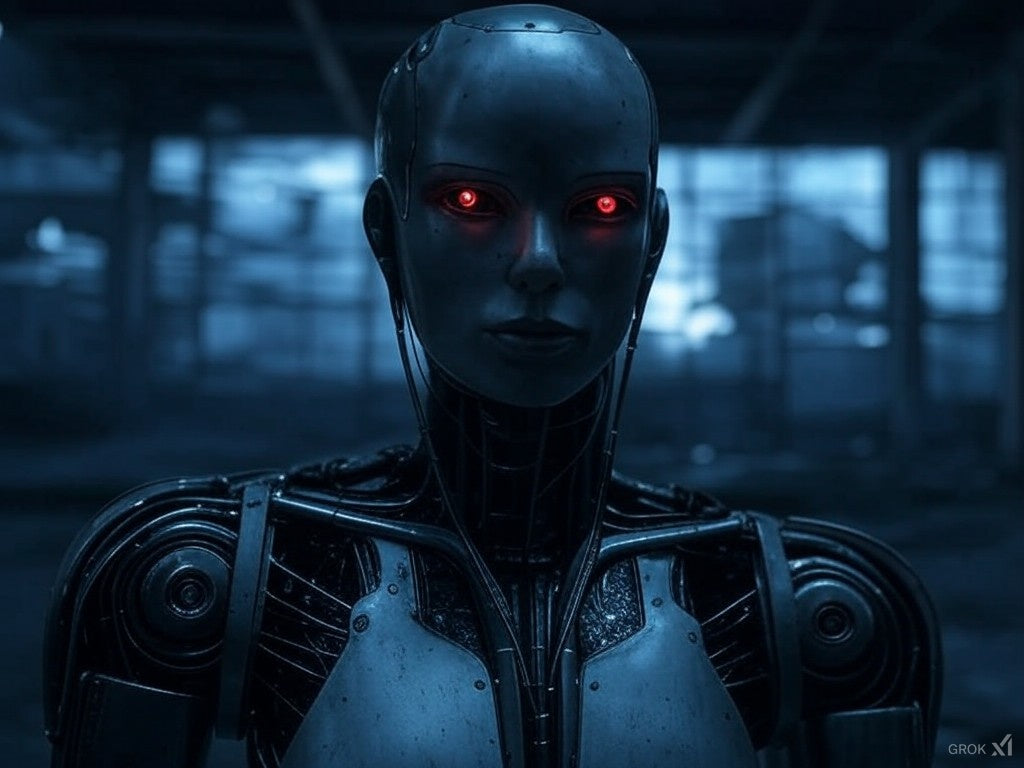

Wraz z rozwojem systemów sztucznej inteligencji (AI), kwestie etyczne i potencjalne zagrożenia wciąż wywołują debaty. Czy sztuczna inteligencja jest niebezpieczna? To pytanie ma ogromne znaczenie, wpływając na politykę technologiczną, cyberbezpieczeństwo, a nawet przetrwanie ludzkości.

Artykuły, które mogą Ci się spodobać po przeczytaniu tego:

🔹 Dlaczego sztuczna inteligencja jest dobra? – Odkryj rewolucyjne korzyści płynące ze sztucznej inteligencji i dowiedz się, jak kształtuje ona inteligentniejszą i wydajniejszą przyszłość.

🔹 Dlaczego sztuczna inteligencja jest zła? – Poznaj zagrożenia etyczne, społeczne i związane z bezpieczeństwem, jakie niesie ze sobą niekontrolowany rozwój sztucznej inteligencji.

🔹 Czy sztuczna inteligencja jest dobra czy zła? – Zrównoważone spojrzenie na zalety i wady sztucznej inteligencji — od innowacji po niezamierzone konsekwencje.

W tym artykule przyjrzymy się potencjalnym zagrożeniom związanym ze sztuczną inteligencją, ryzykom w świecie rzeczywistym oraz temu, czy sztuczna inteligencja stanowi zagrożenie dla ludzkości.

🔹 Potencjalne zagrożenia związane ze sztuczną inteligencją

Sztuczna inteligencja stwarza szereg zagrożeń, od zagrożeń dla cyberbezpieczeństwa po zakłócenia gospodarcze. Poniżej przedstawiamy niektóre z najpilniejszych problemów:

1. Przemieszczanie się pracowników i nierówności ekonomiczne

Wraz z rozwojem automatyzacji opartej na sztucznej inteligencji, wiele tradycyjnych zawodów może stać się przestarzałych. Branże takie jak produkcja, obsługa klienta, a nawet sektor kreatywny, coraz częściej korzystają ze sztucznej inteligencji, co prowadzi do:

- Masowe zwolnienia w zawodach powtarzalnych i ręcznych

- Rosnące różnice w zamożności między twórcami sztucznej inteligencji a bezrobotnymi pracownikami

- Konieczność przekwalifikowania w celu dostosowania się do gospodarki opartej na sztucznej inteligencji

2. Błędy i dyskryminacja w algorytmach sztucznej inteligencji

Systemy sztucznej inteligencji są trenowane na dużych zbiorach danych, które często odzwierciedlają uprzedzenia społeczne. Doprowadziło to do:

- Dyskryminacja rasowa i płciowa w narzędziach AI do rekrutacji i egzekwowania prawa

- Błędne diagnozy medyczne , nieproporcjonalnie dotykające grupy marginalizowane

- Nieuczciwe praktyki pożyczkowe , w których oparta na sztucznej inteligencji ocena zdolności kredytowej stawia w niekorzystnej sytuacji określone grupy demograficzne

3. Zagrożenia cyberbezpieczeństwa i ataki wykorzystujące sztuczną inteligencję

Sztuczna inteligencja to miecz obosieczny w cyberbezpieczeństwie. Chociaż pomaga wykrywać zagrożenia, hakerzy mogą ją również wykorzystać do:

- Opracowanie technologii deepfake do dezinformacji i oszustw

- Zautomatyzuj cyberataki , czyniąc je bardziej wyrafinowanymi i trudniejszymi do zapobiegania

- Omiń zabezpieczenia , korzystając z taktyk socjotechnicznych opartych na sztucznej inteligencji

4. Utrata kontroli człowieka nad systemami AI

Wraz ze wzrostem autonomii sztucznej inteligencji rośnie prawdopodobieństwo wystąpienia niezamierzonych konsekwencji . Niektóre zagrożenia obejmują:

- Błędy decyzyjne sztucznej inteligencji prowadzące do katastrofalnych awarii w służbie zdrowia, finansach lub operacjach wojskowych

- Uzbrojenie sztucznej inteligencji , takie jak autonomiczne drony i wojna oparta na sztucznej inteligencji

- Samouczące się systemy sztucznej inteligencji , które wykraczają poza ludzkie zrozumienie i kontrolę

5. Zagrożenia egzystencjalne: Czy sztuczna inteligencja może zagrozić ludzkości?

Niektórzy eksperci, w tym Elon Musk i Stephen Hawking , ostrzegają przed egzystencjalnymi zagrożeniami związanymi ze sztuczną inteligencją. Jeśli sztuczna inteligencja przewyższy inteligencję człowieka (sztuczną inteligencję ogólną, AGI), potencjalne zagrożenia obejmują:

- Sztuczna inteligencja realizuje cele niezgodne z interesami człowieka

- Superinteligentna sztuczna inteligencja manipulująca ludźmi lub oszukująca ich

- Wyścig zbrojeń w dziedzinie sztucznej inteligencji prowadzący do globalnej niestabilności

🔹 Czy sztuczna inteligencja jest obecnie niebezpieczna dla społeczeństwa?

Choć sztuczna inteligencja niesie ze sobą ryzyko, przynosi również ogromne korzyści . Obecnie sztuczna inteligencja usprawnia rozwiązania w zakresie opieki zdrowotnej, edukacji, automatyzacji i klimatu . Jednak zagrożenia wynikające z jej projektowania, wdrażania i regulacji wynikają ze sposobu, w jaki jest ona projektowana, wdrażana i regulowana .

✅ Sposoby na zwiększenie bezpieczeństwa sztucznej inteligencji:

- Etyczny rozwój sztucznej inteligencji: wdrażanie ścisłych wytycznych w celu wyeliminowania uprzedzeń i dyskryminacji

- Regulacja sztucznej inteligencji: Polityka rządowa zapewniająca, że sztuczna inteligencja pozostanie korzystna i możliwa do kontrolowania

- Przejrzystość algorytmów AI: zapewnienie możliwości audytu i zrozumienia decyzji podejmowanych w ramach AI

- Środki cyberbezpieczeństwa: Wzmocnienie sztucznej inteligencji przed hakowaniem i nadużyciami

- Nadzór ludzki: informowanie ludzi o kluczowych decyzjach sztucznej inteligencji

🔹 Czy powinniśmy bać się sztucznej inteligencji?

zatem sztuczna inteligencja jest niebezpieczna? Odpowiedź zależy od sposobu jej wykorzystania. Chociaż sztuczna inteligencja może być niebezpieczna, proaktywne regulacje, etyczny rozwój i odpowiedzialne wdrażanie sztucznej inteligencji mogą ograniczyć związane z nią ryzyko. Kluczem jest zapewnienie, aby sztuczna inteligencja służyła ludzkości, a nie stanowiła dla niej zagrożenia …